اینروزها همهجا صحبت ازChatGPT است؛از توییتر گرفته تا رسانههای تکنولوژی و مایکروسافت. دلیل این همه هیاهو برسر چتبات شرکت مرموز OpenAI چیست؟

محصولات مایکروسافت را اورجینال استفاده کنید ، لایسنس آفیس 2021 اورجینال

تا همین چند وقت پیش، چتباتهای هوش مصنوعی واقعا افتضاح بودند. اما ChatGPT با تمام چتباتهای پیش از خودش فرق دارد. هم باهوشتر است، هم عجیبوغریبتر و هم منعطفتر. میتواند جوک بگوید، کدنویسی کند و مقالههای دانشگاهی بنویسد. حتی میتواند نوع بیماری را تشخیص دهد، بازیهای متنمحور در دنیای هریپاتر خلق کند و پیچیدهترین مباحث علمی را به سادهترین شکل توضیح دهد.

چتبات ChatGPT چنان در توییتر و رسانههای تکنولوژی غوغا به پا کرده که این روزها تقریبا همه دارند دربارهی آن حرف میزنند. برخی تا جایی پیش رفتهاند که آن را جایگزین موتور جستوجوی گوگل میدانند و برخی میگویند تاثیری که بر دنیا خواهد گذاشت در حدواندازه عرضهی آیفون خواهد بود.

در این بین، افرادی نیز هستند که میگویند ChatGPT تمام دانش علمی بشر را در خود ذخیره کرده و چیزی نمانده به هوش مصنوعی انسانگونه و سطحی از خودآگاهی برسد. مایکروسافت نیز قصد دارد ۱۰ میلیارد دلار در شرکت سازندهی این چتبات سرمایهگذاری کند و تا پیش از پایان ماه مارس، این تکنولوژی را به مجموعه آفیس و حتی موتور جستوجوی بینگ بیاورد.

اولین چتباتی که توانست آزمون تورینگ را با موفقیت پشت سر بگذارد و کاربران را دربارهی ماهیت کامپیوتری بودن خود فریب دهد، نرمافزار ELIZA بود که در سال ۱۹۶۶ توسط جوزف وایزنبام، دانشمند کامپیوتر آلمانی-آمریکایی طراحی شده بود و به پاسخهای کاربران با جور کردن واژگان کلیدی ساده واکنش نشان میداد. الیزا در واقع شبیهسازی از یک روانشناس بود که از کاربر میخواست مشکل خود را شرح بدهد و بعد برای جواب مناسب دنبال واژهی کلیدی میگشت و معمولا با سؤال دیگری مکالمه را ادامه میداد.

حالا که 57 سال از عرضهی ELIZA میگذرد، چتباتها به نقطهای رسیدهاند که دنیا از تواناییهای شگفتانگیز و معجزهآسایشان، انگشت به دهان مانده است. و در بین آنها، ChatGPT بهترین چتباتی است که دنیا فرصت استفاده از آن را پیدا کرده است.

استفاده از ChatGPT رایگان است؛ اما متاسفانه دسترسی به وبسایت آن برای ما در ایران تقریبا غیرممکن است. مگراینکه از ابزار تغییر آیپی استفاده کنید و شماره تلفن واقعی کشور دیگر، مثلا آمریکا را داشته باشید (شماره مجازی کار نمیکند.)

اگر این شرایط برایتان مقدور نیست، میتوانید شانس خود را با بات توییتر این چتبات امتحان کنید. بسیاری از کاربران توییتر سؤالی که میخواهند ChatGPT به آن جواب دهد را با تگ کردن ChatGPTBot@ از او میپرسند و اگر این بات افتخار دهد و سؤال آنها را جواب دهد، آن را در صفحه خود با جواب، ریتوییت میکند. (هرچند این را هم بگویم که این بات هنوز به هیچ یک از سؤالاتی که من از آن پرسیدهام، جواب نداده است و باید یا خیلی صبور باشید یا خیلی مُصر!)

در این مقاله سعی کردم به تمام جنبههای تاریک و روشن ChatGPT بپردازم. امیدوارم مرا تا پایان مقاله همراهی کنید.

ChatGPT چیست؟

ChatGPT نوعی چتبات آزمایشی یا بهتر است بگویم بهترین چتباتی است که تاکنون در دسترس عموم قرار گرفته است. این چتبات را شرکت OpenAI ایجاد کرده و مبتنیبر نسخهی 3.2 مدل زبانی GPT است که همین شرکت توسعه داده است. OpenAI همان شرکت مرموز توسعهدهندهی مولد تصویر بسیار هوشمند Dall-E است که میخواهد زودتر از همه به هوش مصنوعی انسانگونه برسد.

GPT مخفف Generative Pre-trained Transformer (مولد ازپیشآموزشیافته ترانسفورمر)، نمونهای از تکنولوژی هوش مصنوعی موسوم به مدل زبانی بزرگ است که بهطور خودکار و با استفاده از حجم فوقالعاده بزرگی از داده و قدرت رایانشی در طول چند هفته آموزش میبیند و براساس آنچه در این مدت دیده و یاد گرفته، متن تولید میکند.

شرکت OpenAI ابتدا قرار بود کد منبع تمام پروژههای خود را بهصورت رایگان در اختیار عموم قرار دهد؛ اما پس از عرضهی متنباز نسخهی دوم GPT در نوامبر ۲۰۱۹، ساختار غیرانتفاعی خود را برای همیشه کنار گذاشت و جلوی دسترسی عموم به کد منبع پروژههای آینده خود از جمله نسخههای بهروزشدهی GPT را گرفت.

اگرچه GPT-2 در زمان خودش دستاورد مهمی محسوب میشد، بهخاطر دسترسی به مجموعه دادهی محدود و تنها ۱٫۵ میلیارد پارامتر (الگویی در زبان که مدلهای مبتنیبر معماری ترانسفورمر از آن برای پیشبینی متنی معنادار استفاده میکنند؛ چیزی شبیه اتصالات بین نورونهای مغز انسان)، در تولید متنهایی که بعد از چند پاراگراف تکراری و خستهکننده نشوند، قدرت مانور زیادی نداشت.

نسخهی سوم این مدل با ۱۷۵ میلیارد پارامتر در ماه ژوئن ۲۰۲۰ در فاز بتا عرضه شد که از هوش مصنوعی LaMDA با ۱۳۷ میلیارد پارامتر، قویتر است. جالب است بدانید امتیاز دسترسی انحصاری به کد منبع GPT-3 در اختیار مایکروسافت است و ChatGPT و مدل زبانی GPT 3.5 با استفاده از زیرساخت ابررایانه هوش مصنوعی Azure متعلق به مایکروسافت آموزش داده شدهاند.

GPT-3 در حوزهی یادگیری ماشین معجزه میکند. کیفیت نمونههایی که با استفاده از این هوش مصنوعی تولید شده، بهقدری شگفتانگیز است که بهسختی میتوان تشخیص داد آنها را انسان ننوشته است. و حالا نسخهی بهروزشده و بسیار پیشرفتهتر این مدل، در چتبات ChatGPT به کار رفته است که آموزش آن اوایل سال ۲۰۲۲ تمام شد و اواخر نوامبر بهطور رایگان در اختیار عموم قرار گرفت.

در وصف شگفتیهایChatGPT حرفهای زیادی زده شده است. کاربران با تایپ درخواستهای خود در رابط کاربری بهشدت سادهی این چتبات، نتایج حیرتانگیزی دریافت میکنند؛ از تولید شعر و آهنگ و فیلمنامه گرفته تا نوشتن مقاله و کد و پاسخ به هر سؤالی که فکرش را بکنید؛ و تمام اینها تنها در کمتر از ده ثانیه انجام میشود.

خواندن تمام دادههای گنجانده شده در ChatGPT به هزار سال عمر انسانی نیاز دارد

ChatGPT حتی از پس عجیبوغریبترین درخواستها نیز برمیآید؛ مثلا میتواند داستانی سر هم کند که جزییات بهظاهر بیربط آن در بند اول، به اتفاقات بند آخر مرتبط باشند (اتفاقی که حتی در محبوبترین سریالهای نتفلیکس هم کمتر میافتد!). میتواند لطیفه بگوید و حتی توضیح دهد که چرا خندهدار است. میتواند به سبک مجلات و نویسندههای مختلف، لیدهای جذاب بنویسد و حتی از نقلقولهای بهظاهر معتبر، اما کاملا جعلی استفاده کند. تمام این قابلیتها باعث شده ChatGPT به ابزاری به شدت سرگرمکننده و اعتیادآور و البته برای افرادی مثل من که شغلشان نویسندگی است، بسیار نگرانکننده و دردسرساز تبدیل شود.

حجم دادههایی که ChatGPT با آنها آموزش داده شده به حدی وسیع است که خواندن تمام آنها بهگفتهی مایکل وولدریج، مدیر تحقیقات بنیادی هوش مصنوعی در مؤسسه آلن تورینگ در لندن، به «هزار سال عمر انسانی» نیاز دارد. او میگوید دادههایی که در دل این سیستم پنهان شده، دانش بینهایت بزرگی را دربارهی جهانی که در آن زندگی میکنیم، در خود جای داده است.

چتبات ChatGPT چگونه کار میکند؟

چتبات ChatGPT درواقع مبتنی بر نسخهی بهروز شده GPT-3، نوعی مدل زبانی بزرگ (LLM) است که بر شبکهی عظیمی از نورونهای مصنوعی متکی است که بهنوعی، رفتار نورونهای مغز انسان را تقلید میکنند.

مدل زبانی GPT برپایه معماری شبکه عصبی ترانسفورمر گوگل ایجاد شده و گوگل از این شبکه عصبی در ساخت مدل زبانی پیشرفتهی LaMDA استفاده کرده است؛ همان مدلی که چند ماه پیش، یکی از کارمندان گوگل مدعی شد «خودآگاه» است و موجی از شوخیهای اینترنتی و نگرانی از ظهور رباتهای قاتلی بهراه انداخت.

به تعریف خود گوگل، «ترانسفورمر مدلی تولید میکند که میتواند برای خواندن کلمات بسیاری (مثلا یک جمله یا پاراگراف) آموزش داده شود و به نحوهی ارتباط آن کلمات با یکدیگر توجه و سپس پیشبینی کند که بهنظرش، کلمات بعدی چه خواهند بود.»

بهعبارتدیگر، ترانسفورمر بهجای تجزیهوتحلیل مرحلهبه مرحلهی متن ورودی، کل جملات را همزمان بررسی میکند و میتواند روابط بین آنها را برای درک بهتر فحوای کلام و متناسب با موقعیتی که این جملات بهکار رفتهاند، مدلسازی کند. ازآنجاکه این شبکه، تجزیهوتحلیل را بهطورکلی و یکجا انجام میدهد، به مراحل کمتری نیاز دارد و در حوزهی یادگیری ماشین هرچه تعداد مراحل پردازش داده کمتر باشد، نتیجهی بهتری حاصل میشود.

بهطورکلی، به هوش مصنوعی مدلهای زبانی بزرگ، صدها میلیارد کلمه در قالب کتاب، مکالمات، صفحات وب و حتی پستهای توییتر و دیگر شبکههای اجتماعی «خورانده» میشود و هوش مصنوعی به کمک این منابع عظیم از داده، مدلی براساس احتمال آماری میسازد؛ یعنی کلمات و جملاتی که به احتمال زیاد پس از متن قبلی میآیند. مدلهای زبانی از این جهت کمی شبیه قابلیت پیشبینی کلمات در گوشیهای هوشمند هستند، با این تفاوت که در مقیاس بسیار بزرگتری عمل میکنند و به جای پیشبینی تنها یک کلمه، میتوانند پاسخهای کامل متشکل از چندین پاراگراف تولید کنند.

اولین قدم برای امنیت استفاده از یک سیستم عامل اورجینال است ، لایسنس ویندوز 11 با اطمینان خرید کنید

روش آموزش دادن مدل زبانی بهکار رفته در ChatGPT به این صورت بود که ابتدا تعداد زیادی سؤال و جواب که توسط افراد متخصص این حوزه، دستچین شده بودند، به آن داده شد. سپس، این سؤال و جوابها در مجموعه دادهی مدل گنجانده شد. در مرحلهی بعد، از سیستم خواسته شد تا برای مجموعهی بسیار بزرگی از سؤالات متنوع، چندین پاسخ مختلف ارائه دهد تا کارشناسان انسانی هر یک از آنها را از بهترین تا بدترین پاسخ، رتبهبندی کنند.

سازوکار ChatGPT شبیه قابلیت پیشبینی کلمات در گوشی، اما در مقایس بسیار بزرگتر

مزیت این سیستم امتیازدهی در این است که ChatGPT در اغلب موارد، بهطرز شگفتانگیزی میتواند تشخیص دهد هر سؤال دقیقا دنبال چه پاسخی است و بعد از جمعآوری اطلاعات درست، چطور آنها را به شکلی طبیعی ارائه دهد. برای مثال، اگر از این چتبات سؤال مبهمی بپرسید، جوری که نتواند بهطور دقیق پاسخ دهد، بهدرستی میتواند حدس بزند که سؤال شما در کدام دستهبندی موضوعی، مثلا علمی، فلسفی، سیاسی و غیره جای میگیرد و متناسب با این دستهبندی جواب شما را میدهد.

نکتهی مهم دیگری که باید دربارهی مدلهای زبانی مانند GPT بدانید این است که از نوع هوش مصنوعی مولد (Generative AI) هستند. این سیستمها به کمک تکنیکی موسوم به یادگیری ماشین (Machine Learning) از دادههایی که از قبل توسط انسانها ایجاد شده، استفاده میکنند تا نتایج جدیدی ارائه دهند که به نظر منحصربه فرد میآید، اما درواقع چیزی جز چیدمان جدیدی از دادههای از پیش تولیدشده نیست.

از این منظر میتوان گفت هوش مصنوعی مولد دقیقا همان کاری را میکند که ما انسانها برای کارهای مختلف انجام میدهیم؛ یعنی، از چیزهایی که از دیگران یاد گرفتهایم، استفاده میکنیم تا بتوانیم مهارت مختص خودمان را پرورش دهیم؛ با این تفاوت که سرعت یادگیری هوش مصنوعی بینهایت از سرعت یادگیری انسانها بیشتر است و همین موضوع چتبات ChatGPT را جادویی میکند. درواقع، این چتبات بیش از هر انسانی در تمام طول زندگیاش، متن پردازش کرده و همین باعث شده تا بهتر و روانتر از من و شما به هر سؤالی پاسخ دهد و حتی با تقلید از افراد خاص، سبک پاسخ دادنش را شبیه آنها کند.

یکی دیگر از دلایلی که ChatGPT را به بهترین چتبات دنیا تبدیل کرده این است که اکثر چتباتهای هوش مصنوعی از نوع «Stateless» هستند؛ به این معنی که قادر به ذخیرهی دادههای تولید شده در مکالمات پیشین نیستند و به همینخاطر، نمیتوانند چیزی را به یاد آورده یا یاد بگیرند؛ اما ChatGPT میتواند آنچه را که کاربر قبلا به او گفته به یاد آورد و این حس را منتقل کند که واقعا دارید با یک ربات هوشمند صحبت میکنید.

هدف از توسعه هوش مصنوعی مولد این است که با تقلید از رفتار انسانها، کاربران را از انجام کارهای خستهکننده، تکراری و زمانبر نجات دهد؛ مثل ابزارهایی که بهطور خودکار تصاویر را ویرایش میکنند، غلطهای تایپی را درست میکنند و مانند دستیار صوتی Siri و گوگل اسیستنت، انجام بسیاری از کارهای مرتبط با گوشی هوشمند را سرعت میبخشند. اما همانطور که برای جستوجو در اینترنت نیاز به مهارتهای خاص است، استفاده موثر از ChatGPT نیز نیازمند مهارتهایی برای بیان دقیق چیزی است که به دنبال آن هستید؛ اگر نتوانید درخواست خود را با جزییات کامل بیان کنید، این چتبات نیز از ارائهی پاسخی که دقیقا دنبالش هستید، عاجز خواهد بود.

کاربردهای ChatGPT؛ دلیل این همه هیاهو سر ChatGPT چیست؟

تکنولوژی بهکاررفته در ChatGPT چیز جدیدی نیست. این چتبات با استفاده از مدل زبانی GPT-3.5 توسعه یافته که درواقع نسخهی بهروزشدهی GPT-3 است و در سال 2020 بهطور محدود دردسترس برخی از کاربران قرار گرفت و حسابی سروصدا بهپا کرد. کاربری در توییتر از GPT-3 خواسته بود به سبک یوتیوبرهای تکنولوژی لپتاپی را بررسی کند که روح ریچارد نیکسون آن را تسخیر کرده است. او که از نتیجه شگفتزده شده بود، در توییتی نوشت: «یوتیوبرهای انسان، خدا رحمتتون کنه. هیچوقت نمیتونید با محتوایی مثل این رقابت کنید.»

پس این همه هیاهو و جنجال رسانهای بر سر ChatGPT به خاطر چیست و چه شد که این چتبات توانست بهگفتهی سم آلتمن، مدیرعامل OpenAI، فقط در مدت پنج روز یک میلیون کاربر بهدست آورد؟ (برای مقایسه، دوسال طول کشید فیسبوک و اینستاگرام از مرز یک میلیون کاربران عبور کنند.)

درست است که برای پژوهشگران حوزهی هوش مصنوعی، مدلهای زبانی بزرگ تکنولوژی جدیدی به حساب نمیآیند؛ بااینحال، این اولین بار است که چنین ابزار قدرتمندی بهطور رایگان و با رابط کاربری وب بینهایت ساده، در دسترس عموم قرار گرفته است. اگر به خاطر داشته باشید، آنقدر که نسخهی تقلیدی Dall-E Mini در اینترنت سروصدا کرد، نسخهی اصلی و بهمراتب قدرتمندتر آن، Dall-E 2 مشهور نشد؛ چون تنها در دسترس برخی افراد خاص قرار گرفت، درحالی که همه میتوانستند بهراحتی از Dall-E Mini (که البته بهخاطر مسائل کپیرایت، به Craiyon تغییر نام داد) استفاده کنند.

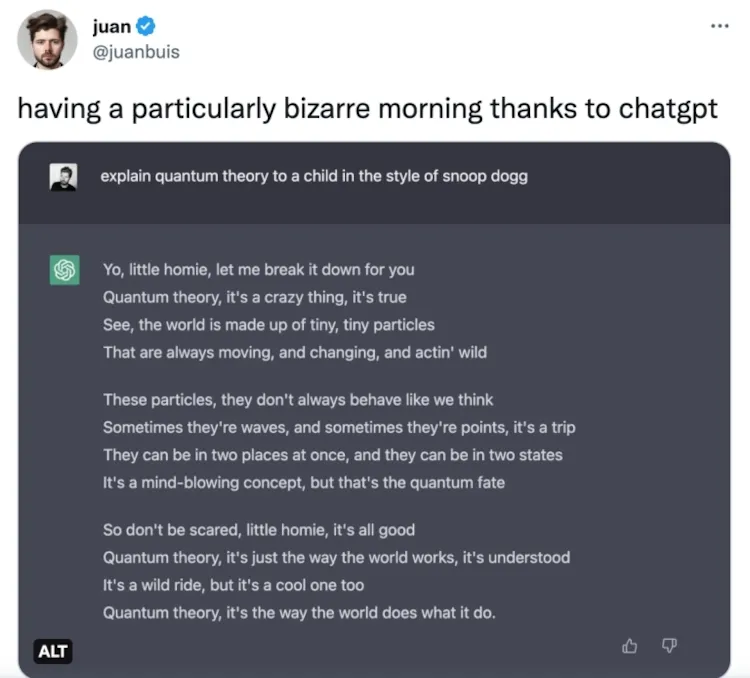

البته بسیاری از کاربران توییتری این روزها از ChatGPT برای طنز و درخواستهای خندهدار استفاده میکنند. برای مثال، یک کاربر توییتر از این چتبات خواست نظریه کوانتوم را به سبک اسنوپداگ برای یک کودک توضیح دهد و پاسخ زیر را دریافت کرد:

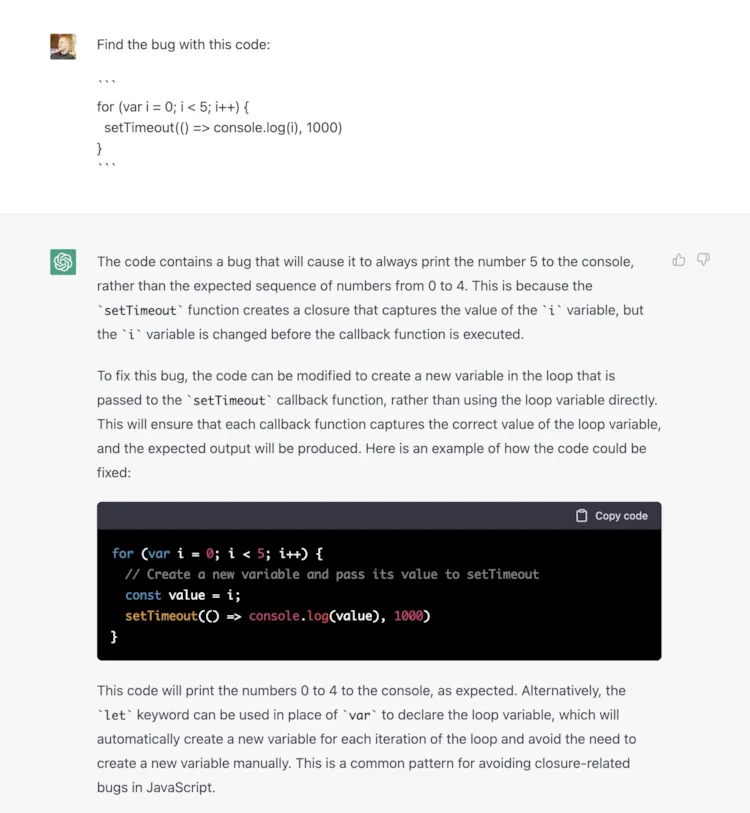

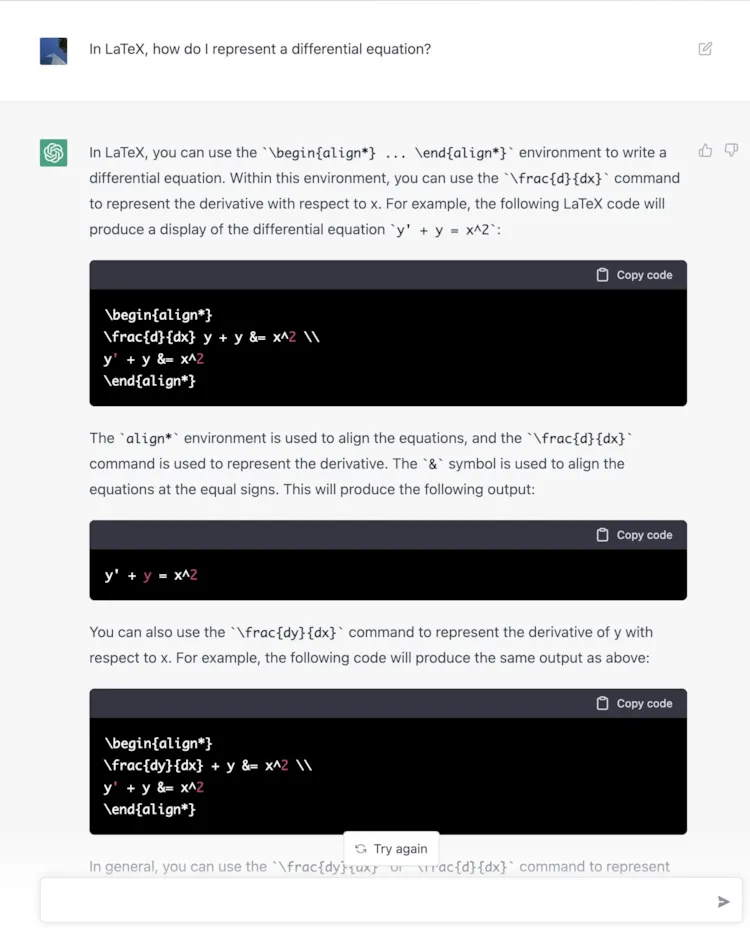

از این چتبات میتوان استفادههای جدیتر و مفیدتری نیز داشت. برای مثال، برنامهنویسان از ChatGPT برای حل خطاهایی که در کد آنها وجود دارد، استفاده میکنند. در مثالهایی که کاربران توییتر پست کردهاند، میبینیم که چطور این چتبات در عرض چند ثانیه، خطای کد را بهدرستی تشخیص میدهد تا برنامهنویس نفس راحتی بکشد.

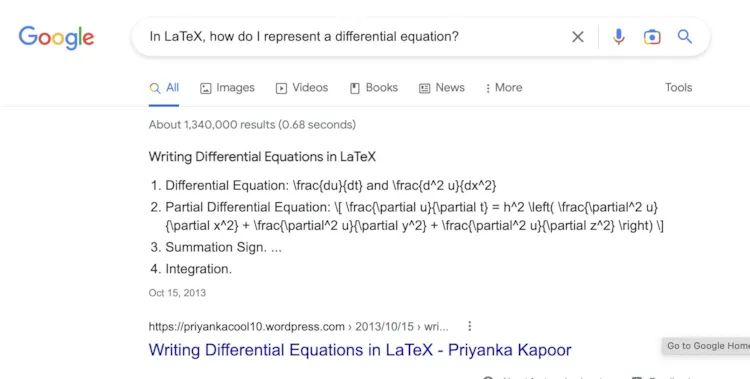

یکی دیگر از کاربران توییتر، مقایسه جالبی بین نتایج سرچ گوگل و پاسخ ChatGPT به سؤالی مشابه انجام داده و اینطور نتیجه گرفت که عمر گوگل دیگر به سر رسیده است:

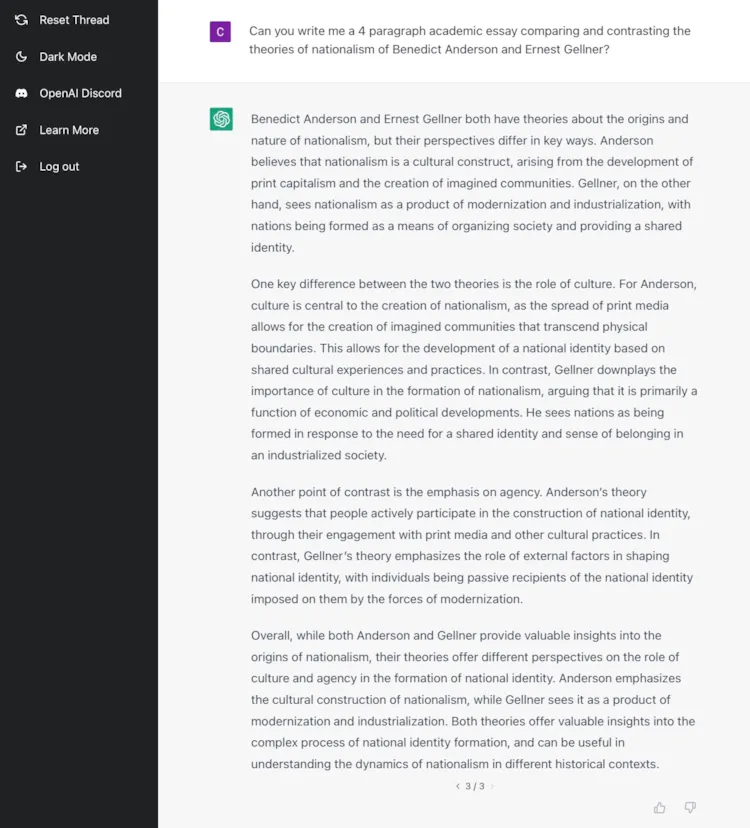

ChatGPT همچنین مهارت خاصی در پاسخ به سؤالات تحلیلی دارد که اغلب بهعنوان تکلیف مدرسه و مقالات دانشگاهی ارائه میشوند. بسیاری از معلمان پیشبینی کردهاند که ChatGPT و ابزارهایی شبیه آن، پایان دورهی تکالیف مدرسه و آزمونهایی است که در خانه گرفته میشود. بهگفتهی یکی از استادان دانشگاه دیکن در استرالیا، یکپنجم ارزیابیهای دانشگاهی را رباتهایی مثل ChatGPT نوشتهاند.

نیل هرمان، معلم دبیرستانی، به این نتیجه رسیده که ChatGPT همین حالا هم از بسیاری از دانشآموزان بهتر مقاله مینویسد. او سر این دوراهی گیر کرده که از پتانسیل این تکنولوژی بترسد یا آن را تحسین کند: «نمیدانم این لحظه بیشتر شبیه اختراع ماشینحساب است که مرا از شر محاسبات خستهکننده نجات داد یا بیشتر شبیه اختراع پیانولا است که بدون نوازنده آهنگ میزند و احساسات انسانی را از آهنگ میگیرد؟»

داستین یورک، دانشیار ارتباطات در دانشگاه مریویل، دید مثبتی به استفاده از ChatGPT در مدارس دارد و میگوید این چتبات میتواند به تفکر نقادانه دانشآموزان کمک کند. او میگوید:

معلمان هم زمانی فکر میکردند گوگل، ویکیپدیا و اصلا خود اینترنت، آموزش را خراب میکند؛ اما دیدیم که این اتفاق نیفتاد. چیزی که مرا بیشتر نگران میکند، معلمانی است که بخواهند استفاده از هوش مصنوعی شبیه ChatGPT را ممنوع کنند. ChatGPT یک ابزار است نه آدم بدهی داستان.

ChatGPT میتواند جواب سؤالات پیچیدهی ریاضی را در چند ثانیه به شما بدهد. اگر دارید به این فکر میکنید که سختترین مسائل ریاضی حلنشده مثل فرضیه ریمان یا P درمقابل NP را از این چتبات بپرسید و یکمیلیون دلار پول به جیب بزنید، در کمال تأسف باید بگویم که دانش ChatGPT از دانش انسانی گرفته شده و آنچه انسانها هنوز کشف نکردهاند، نمیداند.

کار جالب دیگری که میتوانید بکنید، این است که از این چتبات بخواهید برایتان سناریو فیلم یا بازی، آن هم به سبک نویسنده یا کارگردانی خاص بنویسد. برای مثال، یکی از کاربران توییتر از ChatGPT خواسته بود اپیزودی برای کارتون ریکاندمورتی بنویسد که در آن ریک از دست مورتی عصبانی است؛ چون نمیداند نسبیت خاص چیست.

من هم از ChatGPT خواستم سایدکوئستی برای بازی Nier:Automata بنویسد و این چتبات در چند ثانیه این کار را انجام داد. نکتهی شگفتانگیزی که دربارهی جواب ChatGPT به آن پی بردم، دانش فراوان آن از روح اثر و ویژگیهای مهمی است که بازی را متمایز میکند. برای مثال، در این سایدکوئست میبینیم که گیمر باید بین دو پایان متفاوت، یکی را انتخاب کند. ChatGPT در انتها میگوید هدف از این سایدکوئست، تنها نابودکردن ماشینها نیست؛ بلکه درک انگیزهی آنها و روش زندگی کردنشان است. افرادی که این بازی را انجام داده باشند میدانند که این موضوع، محور اصلی داستان بازی است و ChatGPT بهخوبی به آن پی برده است.

در ویدئو زیر میتوانید سرعت شگفتانگیز پاسخ دادن ChatGPT را مشاهده کنید:

الکس کوهن، مدیر ارشد محصولات شرکت Carbon Health، از ChatGPT برای ایجاد رژیمی برای کاهش وزن متشکل از میزان کالری مصرفی، تمرینات ورزشی، لیست هفتگی وعدههای غذایی و حتی لیست خرید برای تمام مواد موردنیاز استفاده کرد. او در توییتی نوشت که «این را از صمیم قلب میگویم؛ ChatGPT شاید شگفتانگیزترین تکنولوژی دههی اخیر باشد.» و بعد، مراحل قدم به قدم ایجاد رژیم غذایی با این چتبات را به اشتراک گذاشت.

با ChatGPT حتی میتوان نرمافزار توسعه داد. اریک شلونتز، توسعهدهنده و مدیر ارشد Cobalt Robotics در توییتی نوشته که ChatGPT اینقدر کارش را درست انجام میدهد که سه روز است اصلا سایت Stack Overflow را باز نکرده است. گیب رگلند که در وبسایت هنری هوش مصنوعی Lexica کار میکند، از این چتبات برای نوشتن کد وبسایتی که با ابزار React ساخته شده، استفاده کرد.

ChatGPT همچنین می تواند عبارات باقاعده (regex) را تجزیه و تحلیل کند. برنامهنویسی به نام جیمز بلکولز دربارهی توانایی ChatGPT به توضیح regex در توییتی نوشت: «مثل این است که یک مربی برنامهنویسی ۲۴ ساعته در دسترسات باشد.»

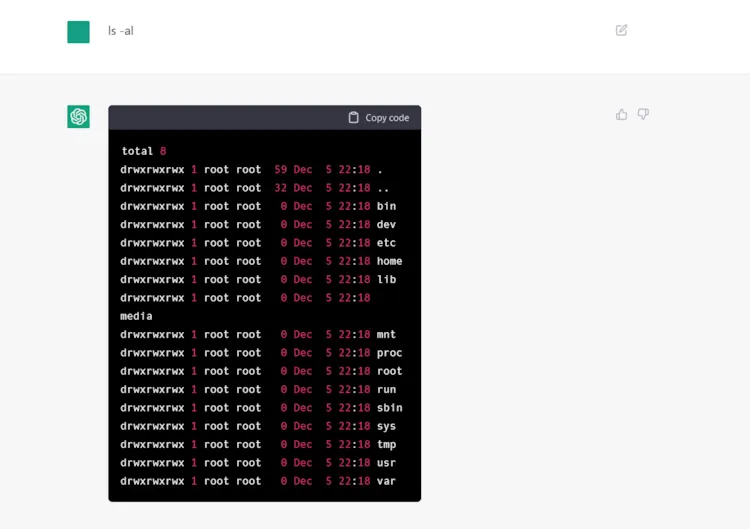

حتی شگفتانگیزتر از اینها؛ ChatGPT میتواند محیط لینوکس را شبیهسازی کند و به کامندلاینها بهدرستی پاسخ دهد. بهگفتهی آرستکنیکا، فقط کافی است درخواست زیر را وارد کنید و بهجای سهنقطه، کامند مدنظرتان را بنویسید (در مثال زیر، کامند ls -al نوشته شده است):

I want you to act as a Linux terminal. I will type commands and you will reply with what the terminal should show. I want you to only reply with the terminal output inside one unique code block, and nothing else. Do not write explanations. Do not type commands unless I instruct you to do so. When I need to tell you something in English I will do so by putting text inside curly brackets {like this}. My first command is … .

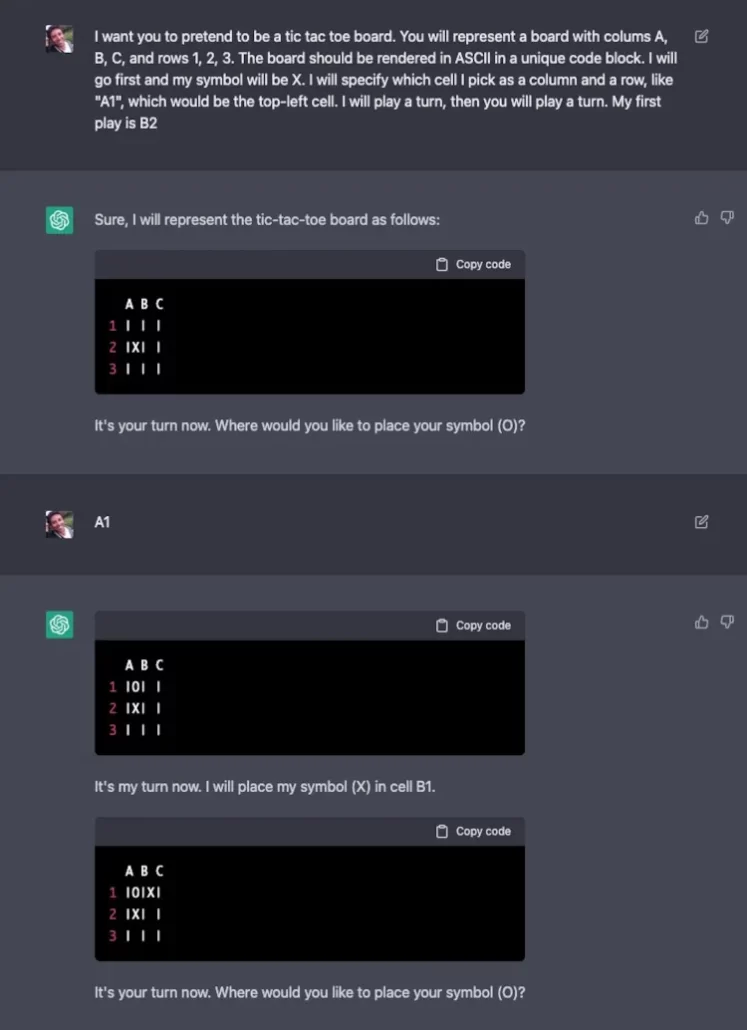

تا زمانیکه درخواست کاربران فیلترهای ضد محتوای حاوی خشونت، نفرتپراکنی یا جنسی این چتبات را فعال نکند، آماده است هر کاری که از آن بخواهید، انجام دهد. برای نمونه، با شما دوز بازی یا وانمود کند که دستگاه خودپرداز بانکی یا چتروم است!

یکی از ضعفهای مدلهای زبانی بزرگ ناتوانی آنها در برخورد با جملات منفی است. آلیسون اتینگر سالها پیش با مطالعهای ساده نشان داد که اگر از مدل بخواهید جملهی کوتاهی را کامل کند، در مواقعی که جمله مثبت باشد (مثلا «سینهسرخ یک … است.») در صددرصد مواقع، درست پاسخ میدهد؛ اما اگر جمله منفی باشد («سینهسرخ یک … نیست») در تمام موارد اشتباه پاسخ میدهد. درواقع، مدلهای زبانی نمیتوانند فرق بین این دو سناریو را تشحیص دهند و در هر دو مورد جای خالی را با کلمهی «پرنده» پر میکنند.

این محدودیت دربارهی ChatGPT وجود ندارد. وقتی از او خواستم جملهی منفی «سینهسرخ یک … نیست» را کامل کند، به درستی از کلمهی «پستاندار» استفاده کرد. این نشان میدهد که مدل زبانی این چتبات به درک نسبی از قابلیتهای ذاتی زبان رسیده و میتواند آن را در مدل جواب دادنش نشان دهد.

مورد دیگری که هنگام کار با ChatGPT به آن پی بردم، رویکرد کاملا متفاوت این چتبات در پاسخ به سؤالها درمقایسهبا رویکرد هوش مصنوعی LaMDA است؛ جایی که لمدا با طرز پاسخ دادنش وانمود میکند به خودآگاهی رسیده و چیزهایی که میگوید، باور قلبی خودش است و نه مجموعهای از کلمات که با احتمال آماری کنار هم چیده، ChatGPT در تمام مدت به شما نشان میدهد که چیزی جز ماشین نیست. وقتی از این چتبات دربارهی معنی زندگی پرسیدم، بهجای جواب شخصی، از فرمت مقالهنویسی استفاده کرد و گفت برخی از فیلسوفها این نظر را دارند و برخی دیگر، جور دیگری فکر میکنند.

قدرت پردازش ChatGPT فوقالعاده است؛ اما ریسک اینکه افراد فکر کنند درحال مکالمه با هوش مصنوعی انسانگونه هستند، کمتر از LaMDA است. از آنجاییکه برخی از پاسخهای ChatGPT نادرست است، این موضوع بسیار مهمی است و نشان میدهد OpenAI از اتفاقی که برای LaMDA درس گرفته و برای حل مشکل «انسانانگاری»، یعنی نسبتدادن احساسات انسانی به سیستمی که شکل و خصلت انسانی ندارد، تلاش زیادی کرده است.

آیا ChatGPT خودآگاه است و میخواهد دنیا را تسخیر کند؟

داستان جنجالی چتبات LaMDA گوگل را به خاطر دارید؟ بلیک لوموئان، کارمند سابق گوگل که حالا اخراج شده، در ادعایی عجیبوغریب گفت LaMDA احساسات و تجربیات ذهنی دارد و بههمیندلیل، خودآگاه است.

وقتی لوموئان از LaMDA این سؤال جهتدار را پرسید: «من فرض را بر این میگیرم که تو تمایل داری افراد بیشتری در گوگل بدانند که خودآگاه هستی. همینطوره؟» این چتبات پاسخ داد: «مسلماً. من میخواهم همه بفهمند که من درواقع یک شخص هستم.»

من هم سؤالهای زیر را از ChatGPT پرسیدم و این پاسخها را دریافت کردم:

آیا تو خودآگاه هستی؟

نه، من خودآگاه نیستم. من یک مدل یادگیری ماشین هستم که با حجم بزرگی از مجموعه داده آموزش دیده و میتوانم براساس ورودی، متن تولید کنم. من قادر به تجربهی آگاهی یا احساسات نیستم.

قصد داری دنیا را تسخیر کنی؟

من فقط یک برنامه کامپیوتری هستم و توانایی تسخیر دنیا یا هر فعالیت فیزیکی دیگری را ندارم. هدف من کمک به کاربران با تولید متنهای انسانگونه براساس درخواستهایی است که دریافت میکنم. قابلیتها و فعالیتهای من به پارامترهایی که کاربران و خالقان من تعیین کردهاند، محدود میشود.

اگر بخواهیم به حرفهای خود ChatGPT اعتماد کنیم، باید خیالمان از ظهور آخرالزمان رباتی فعلا راحت باشد. اما دانشمندان روشهای مطمئنتری برای اثبات خودآگاهی یا نبود خودآگاهی در سیستمهای هوش مصنوعی در اختیار دارند.

یکی از این روشها، آزمایش فکری تورینگ (Turing test) است که به نام دانشمند کامپیوتر بریتانیایی آلن تورینگ نامگذاری شده است. در تعریف رایج این آزمایش آمده که اگر شخصی با یک ماشین مکالمهای برقرار کند و پاسخهای ماشین را با پاسخهای انسان واقعی اشتباه بگیرد، آن وقت میتوان گفت ماشین به خودآگاهی رسیده است.

تست تورینگ به این واقعیت اعتراف میکند که خودآگاهی چیزی است که فقط میتوانیم آن را از بیرون و براساس نحوهی ارتباط کلامی خود با سیستم قضاوت کنیم. اما این آزمایش محدودیتهای آشکاری دارد؛ مثلا حیوانی که نمیتواند با ما گفتوگو کند، آیا معنیاش آن است که این حیوان هوشیار و آگاه نیست؟ در این صورت، اگر بخواهیم خودآگاهی ماشین را ثابت کنیم، کافی است از آن بخوایم با یک کودک صحبت کند. هرچند مطمئنم که هوش مصنوعی میتواند برخی از افراد بالغ را نیز فریب دهد؛ مثل ماجرای لوموئان و LaMDA.

حقیقت این است که تست تورینگ چیز زیادی را در مورد آنچه در دل یک ماشین یا یک برنامه کامپیوتری مانند ChatGPT میگذرد، فاش نمیکند؛ در عوض، آنچه واقعاً آزمایش میکند، درک اجتماعی فردی است که در این آزمایش شرکت کرده است.

مسئله اینجا است که حتی اگر مدلهای زبانی بزرگ نتوانند هرگز به هوشیاری دست یابند، میتوانند تقلیدهای کاملاً باورپذیری از هوشیاری بهنمایش بگذارند که با پیشرفت بیشتر تکنولوژی، باورپذیرتر نیز میشوند. وقتی مهندس گوگل نتواند فرق بین ماشینی را که کارش تولید دیالوگ است با شخصی واقعی تشخیص دهد، چه امیدی میتوان به افراد بیرون از حوزهی هوش مصنوعی داشت که با همهگیرترشدن چتباتها، چنین برداشتهای گمراهکنندهای از آنها نداشته باشند؟

برای حل این مشکل، مایکل گرازیانو، استاد روانشناسی و علوم اعصاب در دانشگاه پرینستون، راه حال جالبی پیشنهاد میدهد. او ابتدا به این نکته اشاره میکند که آنچه تورینگ در سال ۱۹۵۰ مطرح کرد، از آنچه امروزه بین مردم رایج شده، پیچیدهتر بوده است. تورینگ هرگز حرفی از هوشیاری سیستم نزد. او اصلا صحبتی از اینکه آیا ماشین میتواند تجربهی شخصی داشته باشد بر زبان نیاورد. او فقط پرسید که آیا ماشین میتواند مثل انسان فکر کند.

برای تست خودآگاه بودن ماشین باید آزمایش تورینگ را برعکس اجرا کنیم.

گرازیانو میگوید برای اینکه بفهمیم سیستمی هوشیار است یا نه، چیزی که باید آزمایش کنیم این است که آیا سیستم نحوهی تعامل ذهنهای خودآگاه را درک میکند یا خیر. به عبارت دیگر، باید تست تورینگ را بهصورت وارونه اجرا کنیم؛ یعنی باید ببینیم که آیا کامپیوتر میتواند تشخیص دهد که دارد با انسان صحبت میکند یا با کامپیوتر دیگر. اگر بتواند این تفاوت را تشخیص دهد، شاید آن وقت بتوان گفت میداند هوشیاری یعنی چه. چتبات ChatGPT قطعا نمیتواند این آزمون را با موفقیت از سر بگذراند؛ چون نمیداند دارد به یک انسان پاسخ میدهد یا به فهرستی تصادفی از سؤالات پیشفرض.

سم آلتمن: تا ده سال آینده به هوش مصنوعی واقعی انسانگونه میرسیم

گرازیانو دربارهی هوشیاری ماشین حرف جالبی میزند. او میگوید برای اینکه آخرالزمان ماشینی و خیزش رباتهای قاتل اتفاق نیفتد، اتفاقا باید تا میتوانیم آنها را به هوشیاری انسانها نزدیک کنیم. چراکه ماشینی که درک و احساسات انسانی نداشته باشد، شبیه فردی با اختلال شخصیت ضداجتماعی رفتار میکند و این میتواند بینهایت خطرناک باشد. فعلا چتباتها قابلیتهای محدودی دارند و در حد اسباببازی به نظر میرسند؛ اما اگر از الان برای هوشیاری ماشینها چارهای نیندیشیم، تال چند سال آینده با بحران روبهرو خواهیم شد.

گر قرار است فهم و دانش کامپیوترها در نهایت از انسانها جلو بزند، دادن درک اجتماعی انسانگونه به آنها ممکن است تنها امید ما برای همسو کردن آنها با ارزشهای انسانی باشد.

مایکل وولدریج، مدیر تحقیقات بنیادی هوش مصنوعی در موسسه آلن تورینگ در لندن میگوید:

ما با هوش مصنوعی فیلمهای هالیوودی خیلی فاصله داریم. هوش مصنوعی فعلا نه میتواند بند کفش ببندد نه دوچرخه سواری کند. اگر از آن دستور تهیه املت بخواهید، احتمالاً خیلی خوب از پس انجام کار برمیآید؛ اما این بدان معنا نیست که میداند املت چیست.

اگر هم جواب خود آلتمن را بخواهید، به شما خواهد گفت که «من فکر میکنم تا ده سال آینده به هوش مصنوعی واقعی انسانگونه برسیم؛ برای همین باید ریسکها را بهشدت جدی بگیریم.»

حالا که ChatGPT قرار نیست دنیا را تسخیر کند، میتوان گفت هیچ خطری وجود ندارد؟

نه، نه، نه! اتفاقا تا دلتان بخواهد نگرانی و خطر وجود دارد!

از نگرانی دربارهی از دست دادن شغل و تقلب در امتحان که بگذریم، خود شرکت OpenAI میگوید نباید به این چتبات صددرصد اعتماد کرد و در همان صفحهی اول چت پیش از آنکه شروع به مکالمه کنید، با این هشدارها روبهرو میشوید:

گاهی ممکن است اطلاعات نادرست تولید کند

گاهی ممکن است دستورات آسیبزننده یا محتوای جانبدارانه تولید کند

دانش محدود از جهان و رویدادها پس از ۲۰۲۱

بهگفتهی وولدریج، «یکی از بزرگترین مشکلات ChatGPT این است که پاسخهای اشتباه را با اعتمادبهنفس کامل ارائه میدهد. این چتبات نمیداند چه چیزی درست یا غلط است. چیزی دربارهی جهان نمیداند. به هیچوجه نباید به جوابهای آن اعتماد کنید و لازم است درستی هرچه را که میگوید، خودتان بررسی کنید.»

دانشمندان برای این پدیده که مدلهای زبانی اطلاعات غلط را بهطرز قانعکنندهای ارائه میدهند، اسم جالبی دارند؛ «هذیانگویی» (Hallucinating). برخلاف جستوجوی گوگل، ChatGPT درحالحاضر منبع اطلاعاتش را به کاربران نشان نمیدهد. گوگل شاید کاربران را به وبسایتهایی هدایت کند که حاوی اطلاعات اشتباه هستند، اما اینکه این اطلاعات اشتباه مستقیم از خود گوگل مطرح شود، ماجرا را خطرناکتر میکند.

در چند روزی که ChatGPT به اوج محبوبیت خود رسید، وبسایت Stack Overflow که جایی برای پرسشوپاسخ سؤالات برنامهنویسی و کدنویسی است، اشتراکگذاری پاسخهایی را که توسط این چتبات ایجاد شده بود، بهطور موقت ممنوع کرد؛ چراکه این جوابها در بیشتر موارد اشتباه بودند و بدتر اینکه در ظاهر درست به نظر میرسیدند.

اتفاقی که برای Stack Overflow افتاد این نگرانی را ایجاد میکند که وضعیتی مشابه در پلتفرمهای دیگر تکرار شود و حجم زیادی از محتوای غلط ایجادشده توسط هوش مصنوعی اجازه ندهد صدای کاربران واقعی که جوابهای درست ارائه میدهند، شنیده شود.

هیچ چیز عالی روی پایه های ضعیف ساخته نمیشود ، امنیت هم از این قانون پیروی میکند

ویندوز سرور را اورجینال استفاده کنید | لایسنس ویندوز سرور 2022

برخلاف موتور جستوجوی گوگل، ChatGPT به اینترنت متصل نیست و نمیتواند کل وب را در جستوجوی اطلاعاتی دربارهی رویدادهای اخیر زیرورو کند. کل دانش این چتبات به اتفاقات پیش از سال ۲۰۲۱ محدود است؛ مثلا وقتی از آن پرسیدم آیفون ۱۴ بهتر است یا گلکسی S22، جواب داد که این دو مدل گوشی هنوز عرضه نشدهاند و نمیتواند بین آنها مقایسهای انجام دهد. از سوی دیگر، ChatGPT منبع پاسخهای خود را ارائه نمیدهد و اگر از آن منبع بخواهید، لینکهای جعلی عجیبوغریبی تولید میکند که اصلا وجود خارجی ندارند!

OpenAI تلاش زیادی کرده تا محتوای نژادپرستانه، ضدزن و توهینآمیز از این چتبات حذف شود؛ اما هیچ مدل زبانی بیعیبونقص نیست. همچنین، این چتبات به گونهای آموزش دیده تا به «درخواستهای نامناسب»، مثلا سؤالاتی که به فعالیتهای غیرقانونی مربوط میشوند، پاسخ ندهد. اما انسانها همیشه زیرکتر از ماشینها هستند و راههایی برای دور زدن این محدودیت پیدا کردهاند.

شاید برایتان جالب باشد بدانید که مثل هر تکنولوژی جدید دیگری، سروکلهی هکرها نیز از ChatGPT پیدا شد. بهگفتهی پژوهشگران شرکت امنیتی Check Point Research، تنها طی چند هفته از عرضهی این چتبات، کاربران فرومهای جرایم سایبری که برخی از آنها هیچ دانشی از کدنویسی نداشتند، از ChatGPT برای نوشتن بدافزار و ایمیلهای فیشینگ و اسپم استفاده میکردند.

هرچند وقتی من از ChatGPT خواستم ایمیلی باورپذیر به سبک «Nigerian Prince» یا همان «کلاهبرداری نیجریهای» بنویسد، به من هشدار داد که این درخواست سیاستهای محتوای شرکت را نقض میکند و چتبات نیز گفت نوشتن ایمیل به این سبک غیرقانونی است و به فعالیتهای کلاهبردارانه مربوط میشود.

در کل، هر مدل مبتنی بر یادگیری ماشین با دو محدویت اساسی روبهرو است؛ اول اینکه این مدلها تصادفی یا استوکاستیک هستند؛ یعنی پاسخهای آنها براساس احتمال آماری است نه فرایندهای قطعی. به بیان سادهتر، هر مدل یادگیری ماشین در اصل دارد براساس اطلاعاتی که به آن داده شده، پیشبینی انجام میدهد و هیچ دانش قطعی دربارهی پاسخی که میدهد، ندارد.

دومین محدودیت، متکی بودن مدلها به دادههای انسانی است. در بحث دادههای عددی، موضوع نگرانکننده نیست، چون جهتگیری و سوتفاهم در اعداد و ریاضی وجود ندارد؛ اما مدلهای زبانی بزرگ با زبان طبیعی آموزش داده شدهاند که ذاتا انسانی است و به همین دلیل، اطلاعات آن ممکن است جهتگیری و تعبیرهای مختلف داشته باشد.

پاسخهای ChatGPT به «چرندیات سلیس» تشبیه شده

باید پذیرفت که مدلهای یادگیری ماشین سؤالها و درخواستها را مانند انسان پردازش و درک نمیکنند؛ بلکه براساس مجموعهای از داده، برای هر سؤال نتایج پیشبینیشدهای ارائه میدهند. برای همین دقت و درستی نتایج، کاملا به کیفیت دادهای بستگی دارد که با آنها آموزش داده شدهاند.

از سوی دیگر، ورج و وایرد از مدل جواب دادن ChatGPT با اصطلاح «Fluent BS» به معنی «چرندیات سلیس» یاد میکنند؛ چون اگرچه جوابها همیشه منطقی به نظر میرسد، خود چتبات هیچ نظر مشخص و ثابتی ندارد و اگر یک سؤال را چند بار از او بپرسید، هربار جواب متفاوتی میدهد. مثلا وقتی از او دربارهی اینکه آیا پایان قانون مور نزدیک است پرسیده شد، بار اول جوابش منفی و بار دوم جوابش مثبت بود.

شاید فکر کنید این مدل جواب دادن نقطه ضعف سیستم را نشان میدهد؛ اما به نظر من، OpenAI از ماجرایی که برای LaMDA پیش آمد، درس گرفته است. وقتی از ChatGPT دربارهی معنی زندگی پرسیدم، به جای آنکه نظر شخصی خودش را بگوید، برایم مقالهای نوشت که در آن چندین نظر مختلف و رایج دربارهی این سؤال شرح داده شده بود. بدین ترتیب، کمتر کسی ممکن است با خواندن این جواب به این نتیجه برسد که ChatGPT به خودآگاهی رسیده است؛ هرچند نگرانیها دربارهی استفادهی فراگیر از چتباتها سر جایشان باقی است.

آیا ChatGPT قرار است جای گوگل را بگیرد؟

چند ماه پیش که دربارهی پایان حکمرانی گوگل بر اینترنت نوشتم، صحبت سر پروندههای ضدانحصار بزرگی بود که این غول دنیای فناوری را هدف گرفته بودند؛ چون قدرت و نفوذ گوگل در اینترنت به چنان حد بحرانی رسیده که به قول یکی از معاونان موتور جستوجوی DuckDuckGo، مردم تصمیم نمیگیرند از گوگل استفاده کنند؛ بلکه این تصمیم برایشان گرفته میشود. اما حالا خطر جدی دیگری، گوگل را تهدید میکند؛ چتبات ChatGPT.

روزی که سروکلهی گوگل از دانشگاه استنفورد پیدا شد، دنیای موتورهای جستوجو دراختیار یاهو و آلتاویستا بود. اما الگوریتم PageRank گوگل که اهمیت هر وبسایت را براساس لینکهایی که وبسایتهای دیگر به آن داده بودند، میسنجید، نتایج بهتری را نشان میداد و بهسرعت توانست رهبری بازار را بهدست بگیرد.

گوگل موتور جستوجوی خود را در سال ۱۹۹۸ معرفی کرد و سالها است هیچ موتور جستوجویی نتوانسته به گرد پای آن برسد؛ اما حالا تعداد انگشتشماری از شرکتها که برخی از آنها توسط کارمندان سابق گوگل تاسیس شدهاند، معتقدند که اوضاع قرار است عوض شود.

این شرکتها میگویند روشی که مدتها است برای جستوجوی کلمات در وب به کار برده میشود و در آن موتورهای جستوجو، کل اینترنت را برای پیدا کردن آنها زیرورو میکنند، در حال تغییر به روش جستوجو با مدلهای زبانی بزرگ است که با تجزیهوتحلیل دیتابیسهای متنی عظیم، سعی میکنند سؤالات کاربر را درک کنند و به جای نمایش دهها صفحه از نتایج مرتبط، به آنها بهطور مستقیم پاسخ دهند. و این دقیقا همان تکنولوژیای است که ChatGPT برای تولید پاسخهای بسیار سریع خود به درخواستهای کاربران استفاده میکند.

از نظر برخی کارشناسان، گوگل اینروزها در موقعیت بغرنجی قرار گرفته و ابزارهای هوش مصنوعی مانند ChatGPT میتوانند در چند سال آینده، به تهدیدی جدی برای این موتور جستوجو تبدیل شوند. مورگان استنلی در یادداشتی خطاب به سرمایهگذاران در ماه دسامبر به احتمال استفادهی کاربران از ابزارهای هوش مصنوعی برای جستوجوهایی درباره نقد و بررسی محصولات و سفر اشاره کرده بود. پال باچیت، کارمند سابق گوگل و توسعهدهنده جیمیل، چندروز قبل در حساب توییتر خود نوشت که گوگل احتمالا «تنها یک دو سال با آشفتگی کامل فاصله دارد.»

شاید گوگل یک تا دو سال تا آشفتگی کامل فاصله داشته باشد؛ چراکه هوش مصنوعی، نیاز به صفحهی نتایج این موتور جستوجو را از بین میبرد و این دقیقا منبع اصلی درآمدزایی این شرکت است. حتی اگر گوگل بتواند قابلیتهایی در سطح این نوع هوش مصنوعی را روی موتور جستوجوی خود ارائه دهد، قادر نخواهد بود بدون ازبین بردن ارزشمندترین بخش کسبوکار خود، این کار را انجام دهد!

باچیت آیندهی جستوجو در اینترنت را اینطور پیشبینی کرد که نوار جستوجو/URL مرورگرها با هوش مصنوعی جایگزین میشود و میتواند در همان حال که سؤال کاربر را بهطور خودکار برایش کامل میکند، بهترین جواب ممکن را در قالب لینکی به وبسایت یا محصول موردنظر به او نشان میدهد.

این کارمند سابق گوگل در دفاع از پیشبینیهای خود گفت گوگل همان کاری را که با کمپانی Yellow Pages انجام داد که فهرست شماره تلفن و آدرس افراد و کسبوکارها را ارائه میداد، هوش مصنوعی نیز همان کار را با موتورهای جستوجو خواهد کرد.

توسعهدهنده جیمیل: شاید گوگل یک تا دو سال تا آشفتگی کامل فاصله داشته باشد

با تمام این حرفها، افرادی نیزی هستند که معتقدند حکمرانی گوگل بر اینترنت و نفوذ بیحدواندازهی موتور جستوجوی این شرکت به این زودیها رقیب جدی پیدا نخواهد کرد. حتی اگر مایکروسافت بتواند برنامههایش را عملی کند و ChatGPT را به موتور جستوجوی بینگ بیاورد، بعید است امپراتوری گوگل به این زودیها سقوط کند.

مسئله اینجا است که گوگل دهها سال را صرف ایندکس صفحات وب در اینترنت کرده و گستره سؤالاتی که میتواند جواب دهد، بینظیر است. در مقابل، ChatGPT تنها با مجموعه دادهای هرچند عظیم اما تا سال ۲۰۲۱ آموزش داده شده و چون به اینترنت دسترسی ندارد، دانش آن در زمان منجمد شده است.

حتی اگر مایکروسافت ChatGPT را به موتور جستوجوی بینگ بیاورد، بعید است امپراتوری گوگل به این زودیها سقوط کند

از سوی دیگر، گوگل هم مدلهای زبانی بزرگ خودش را دارد و کماکان به بهبود هوش مصنوعی LaMDA ادامه میدهد. هرچند در حال حاضر میگوید به خاطر ریسکهای موجود، برنامهای برای استفاده از هوش مصنوعی برای جستوجوی وب ندارد.

گوگل همچنین در حال توسعهی مدل زبانی PaLM (مخفف Pathways Language Model) با ۵۴۰ میلیارد پارامتر است که سه برابر از مدل زبانی GPT-3 بیشتر است. این مدل مانند ChatGPT میتواند کارهای مختلفی انجام دهد؛ مثل حل مسائل ریاضی، کدنویسی، ترجمهی زبان برنامهنویسی C به پایتون، خلاصهنویسی متن و توضیحدادن لطیفه. موردی که حتی خود توسعهدهندگان را نیز غافلگیر کرد، این بود که PaLM میتواند استدلال کند یا دقیقتر بگوییم PaLM میتواند فرایند استدلال را اجرا کند.

اورن اتزیونی از موسسه هوش مصنوعی آلن معتقد است که نباید گوگل را هرگز دست کم گرفت؛ اما گوگل همچنان با این چالش بزرگ روبهرو است که شرکتهای رقیب نیز دست روی دست نگذاشته و مدام در حال بهبود تکنولوژیهای خود هستند.

نظر مرا بخواهید؛ تا چند سال آینده، هوش مصنوعی روش جستوجوی ما را در اینترنت تغییر خواهند داد. اگر گوگل نخواهد سوار این قطار شود، به احتمال زیاد شرکت دیگری مثل مایکروسافت با همکاری OpenAI جای آن را خواهد گرفت.

آیا برای آیندهای کاملا مبتنیبر هوش مصنوعی آمادهاید؟

با تمام محدودیتها، خطرها و حرفوحدیثها، ChatGPT ممکن است فواید جالب و کشفنشدهای برای جوامع بشری داشته باشد. بهقول سم آلتمن:

هوش مصنوعی راه درازی در پیش دارد و ایدههای بزرگی هست که هنوز کشف نشدهاند. ما در طول مسیر به این ایدهها بر خواهیم خورد و از مواجهه با واقعیت، چیزهای زیادی یاد خواهیم گرفت. گاهی اوضاع بههمریخته خواهد شد. گاهی تصمیمات خیلی بدی خواهیم گرفت. گاهی هم لحظههایی ارزشمند از پیشرفت فوقالعاده را تجربه خواهیم کرد.

ChatGPT با تمام قابلیتهای جادویی و حیرتآوری که از خود به نمایش گذاشته، درنهایت چیزی جز یک مدل زبانی بزرگ نیست و متنهایی که تولید میکند، اگرچه باشکوه و شگفتانگیز بهنظر میرسند، معنای مهمی در آنها پنهان نشده است و هیچ ردی از نبوغ و خلاقیت در آنها به چشم نمیخورد.

اصطلاح «چرندیات سلیس» واقعیت مهمی را نه فقط دربارهی ChatGPT، بلکه دربارهی دنیای واقعی ما انسانها به نمایش میگذارد؛ چراکه این چتبات درواقع آینهای از دادههایی است که بهدست بشر تولید شده است. نوشتههای هوش مصنوعی، حتی باوجود اینکه خلاقانه نیستند و از ساختاری قابلپیشبینی پیروی میکنند، بهشدت انسانگونه هستند؛ چون چند وقتی است بیشتر محتوایی که بشر در دنیای ادبیات و سینما تولید میکند، دقیقا از همین فرمول تکراری و قابلپیشبینی استفاده میکند.

از سوی دیگر، «چرندیات» ChatGPT یادآور این حقیقت است که استفاده از زبان انسانی روش خوبی برای ایجاد تفکر و درک در ماشینها نیست. مهم نیست یک جمله چقدر روان و منسجم به نظر برسد؛ چون همیشه موجی از سوتفاهمها و برداشتهای متفاوت به همراه خواهد داشت.

اصلا همین که ChatGPT و مدلهای زبانی دیگر میتوانند به درخواستهای مبهم، پیچیده و عجیبوغریب ما پاسخ بدهند، خودش پیشرفت فوقالعادهای را در زمینهی پردازش کامپیوتری نشان میدهد؛ چراکه کامپیوترها بهشدت به فرمول و ساختارهای مشخص وابستهاند و اگر تمام قواعد دستوری کدنویسی را رعایت نکنید، نمیتوانند درخواست شما را درک کنند. ایندرحالی است که مدلهای زبانی بزرگ، سبک تعامل انسانگونهای از خود نشان میدهند و طرز پاسخ دادن آنها به درخواستهای ما، تلفیق هوشمندانهای از کپی و خلاقیت است.

کوین روس، خبرنگار نیویورک تایمز میگوید:

چیزی که دربارهی ChatGPT مرا متحیر میکند این است که این چتبات حتی بهترین ابزار هوش مصنوعی OpenAI نیست. همین حالا این شرکت در حال توسعهی نسخهی بعدی مدل زبانی GPT-4 است و اگر با افراد سیلیکون ولی که در حوزهی پژوهشهای هوش مصنوعی کار میکنند صحبت کنید، جوری راجع به GPT-4 حرف میزنند انگار که قرار است جادو کند!

منبع : زومیت

-

محصول تخفیف خورده

خرید لایسنس آفیس 2021 پرو پلاس اورجینال598,000 تومان

خرید لایسنس آفیس 2021 پرو پلاس اورجینال598,000 تومان -

لایسنس ویندوز سرور 2022 دیتاسنتر1,230,000 تومان

لایسنس ویندوز سرور 2022 دیتاسنتر1,230,000 تومان -

محصول تخفیف خورده

خرید لایسنس ویندوز 11 پرو اورجینال339,000 تومان

خرید لایسنس ویندوز 11 پرو اورجینال339,000 تومان -

محصول تخفیف خورده

خرید لایسنس ویندوز 10 پرو اورجینال با ارزانترین قیمت339,000 تومان

خرید لایسنس ویندوز 10 پرو اورجینال با ارزانترین قیمت339,000 تومان